딥러닝

[모두를 위한 딥 러닝 시즌2] 01_Simple_Linear_Regression

Orange57

2020. 7. 16. 19:40

728x90

반응형

SMALL

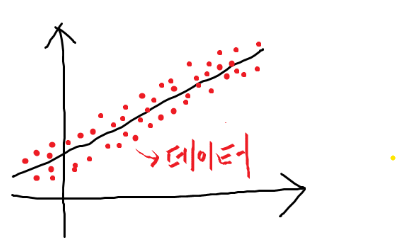

● Linear Regression

> 데이터에 잘 맞는 '직선'을 찾는 것이다.

즉, y=ax+b라는 직선이 있을 때 a와 b를 찾는 것이다.

● Hypothesis

> 어떤 가설이 더 좋을까? = 어떤 식이 더 좋을까?

==> 이것을 정하기 위해서 cost함수를 쓴다.

H(x) = Wx + b

(W : Weight, b : bias)

● Cost

H(x) - y

(예측 값- 실제 값)

=> '빨간색 선'들의 합이 작을 수록 good!

=> 이 차이를 cost, lost, error 라고 함.

==> 어떻게 이 cost 값을 최소화할까?

● Cost function

> error^2의 평균값

H(x) = Wx + b

=> Cost함수를 최소화하는 W와 b를 찾는 것

(학습의 목적이기도 함)

728x90

반응형

LIST